遊戲設計在前天最後一堂落幕,所上的內容跟我的研究居然有那麼點關係!HDR的技術確實已經用在遊戲界多年,跟攝影界所用的方法有些差異,這就是為什麼儘管我已經研究相當多HDR相關知識,我還是想不斷地精進和觸類旁通!就如同近年來走紅的ambient occlusion (AO),概念簡單而作法多,已經呈現百家齊放的現象。

此時我想瞭解全方位影像映射 (Omni-directional Image Mapping)是如何實做,找了網路上的資料,原來是SIGGRAPH ’08裡的課程High dynamic range imaging & image-based lighting中的投影片。

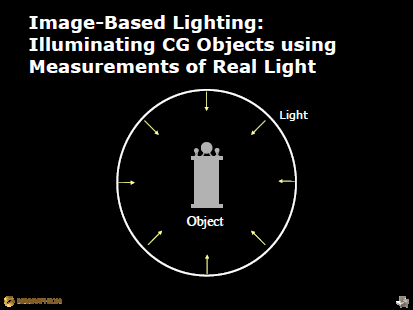

這裡就要解釋Image-based lighting,是3D繪圖技術,牽涉捕捉全方位真實世界的表現當作影像來源,通常會使用專業的攝影機。接著這影像會投影到圓屋頂(dome)或球體(sphere),類似環境映射(environment mapping),而且可以用來模擬物體在場景中的光照效果,使得真實世界中高度細節的光照能照亮場景,而非使用現有的繪圖技術來精確地建立光照模型。

讓環境光紀錄成影像的技術叫做Light Probe Imaging,會使用High Dynamic Range Lighting Environments。這裡先介紹使用鏡射球(mirrored ball)來捕捉環境光(可點圖放大)。

投影片中的網址應該為http://www.pauldebevec.com/Probes/,是SIGGRAPH 2001的課程,才能正確連結到作者Paul Debevec的網頁,頁面中有更多詳細且豐富的資源可以利用。

這張投影片說明環境光如何mapping到物體上,最簡單的方法就是根據物體的法向量,來計算mapping到影像中哪個pixel。

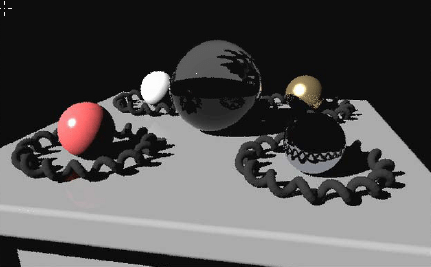

原本物體在ray tracing成像如上,因為沒有環境光,所以背景是黑色的。

加上環境光mapping後得到成像如下(可點圖放大):

遊戲設計老師教導如何使用鏡射球,我就聯想到應該可以使用魚眼鏡頭,果然Omni-directional Image Mapping至少有四種方法,分別是鏡射球(mirrored ball)、魚眼鏡頭(fisheyes)、縫合相片(stitched photos)和掃描(scanning)(點圖可放大)。

關於鏡射球在HDRshop中有更詳細的介紹:http://www.hdrshop.com/。

關於縫合相片在Kaidan有更多的介紹:http://www.kaidan.com/。

關於掃描在Stitched HDRI有進一步的介紹:http://www.gregdowning.com/HDRI/stitched/、High-Resolution Light Probe Image Gallery。

全方位圖像(omnidirectional images)的類型有哪些呢?目前有四種,分別是立方映射(Cube Map)、(Latitude/Longitude)、緯度/經度(Mirrored Ball)、角度映射(Angular Map)。

以上四種型態都有mapping equation,3D to 2D或2D to 3D,HDRshop軟體也有互轉的功能。

參考:遊戲設計投影片、High dynamic range imaging & image-based lighting (SIGGRAPH ’08 SIGGRAPH 2008 classes)、WiKi – Image-based lighting、WiKi – Ambient occlusion、WiKi – Environment mapping。

隨意留個言吧:)~